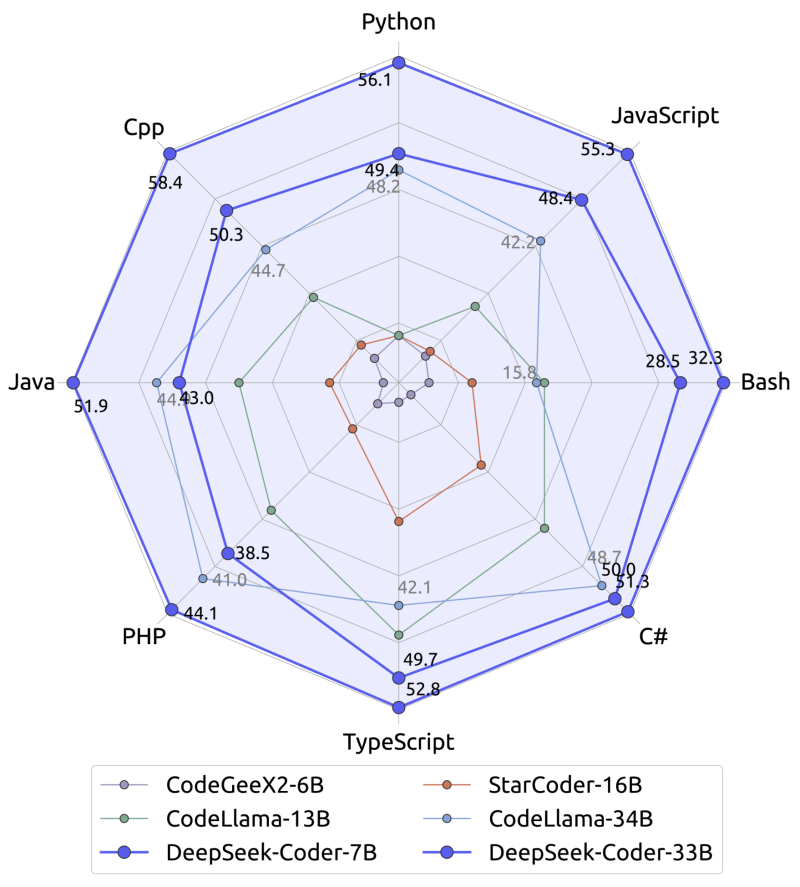

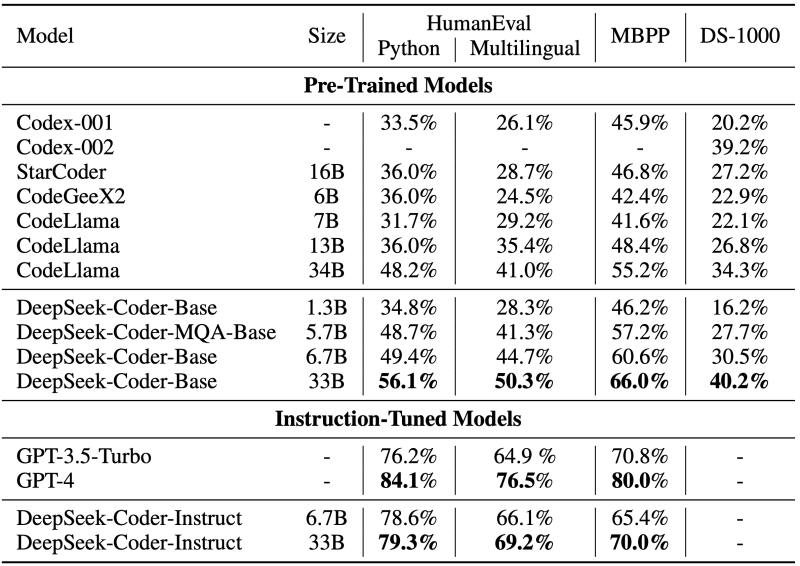

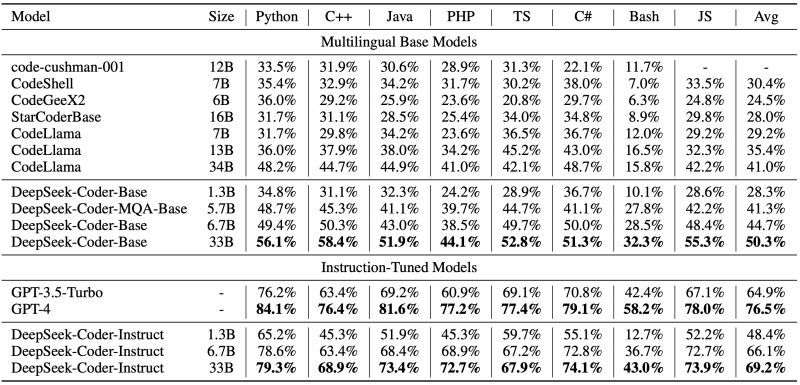

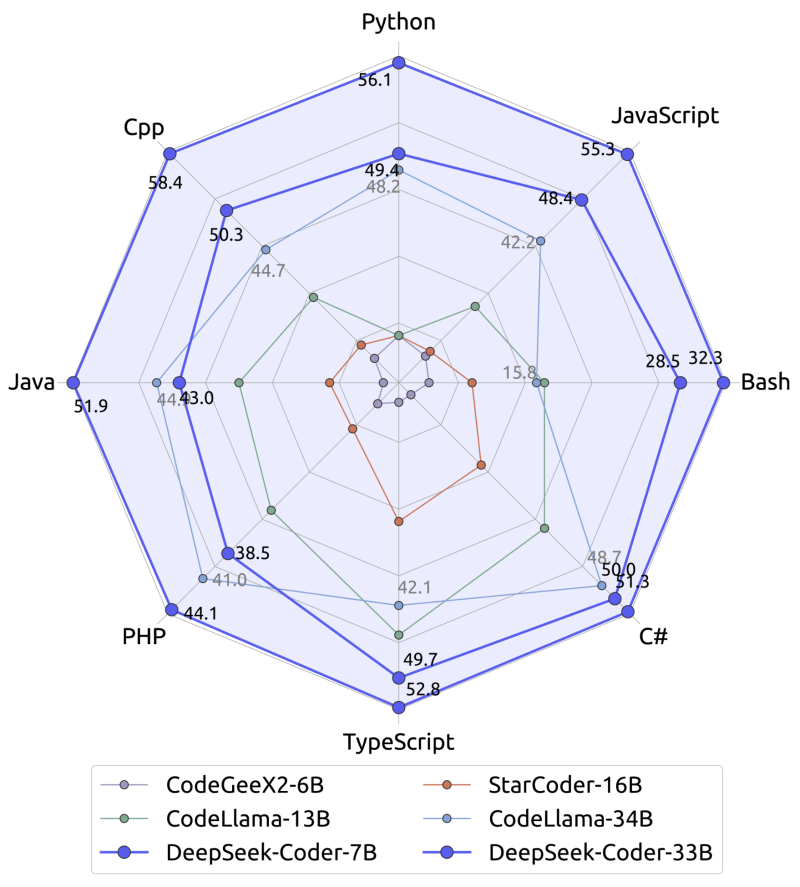

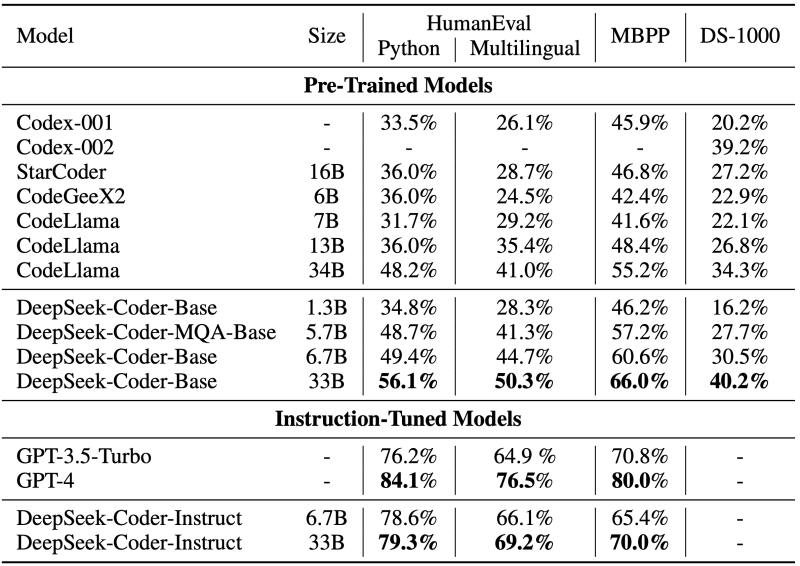

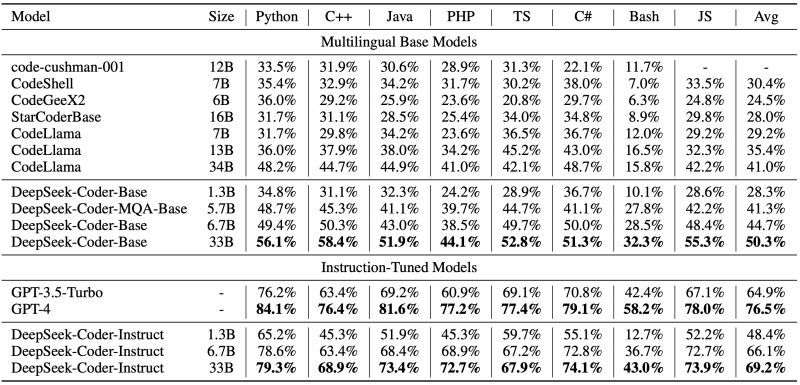

本地部署代码大模型方案,1.3B模型最低只需3GB显存。33B大模型,性能等同于GPT3.5-T①DeepSeek1.3B代码大模型的调试部署,包括运行环境、模型下载、依赖安装和测试程序的运行。最后,对模型在HumanEval基准上的性能进行了测试,结果显示在Python和C++语言下有较好的完成率。同时,文章还对比了DeepSeek Coder与其他开源代码LLMs的能力,结果显示DeepSeek Coder在多项基准测试中表现更优。②模型主要功能:Code-Completion (代码补全):模型可以根据用户输入的部分代码,预测并建议接下来的代码片段,提高编程效率。Chat-Model-Inference (聊天模式推断):模型可以理解用户的自然语言输入,并生成相应的代码片段或解释,类似于聊天机器人。Code-Insertion (代码插入补全):模型不仅能预测接下来的代码片段,还可以在合适的位置插入完整的代码块或结构,减轻开发者手动输入的工作量。Repository-Level Code-Completion (存储库级别代码补全):利用整个存储库中的代码上下文,为开发者提供更智能和个性化的补全建议。Code-Translation (代码翻译):模型可以将代码从一种编程语言翻译成另一种语言。Code-Insertion (添加注释):模型能够为代码添加相应的注释,提高代码的可读性。查看全文

声明:本文仅代表作者观点,不代表本站立场。如果侵犯到您的合法权益,请联系我们删除侵权资源!如果遇到资源链接失效,请您通过评论或工单的方式通知管理员。未经允许,不得转载,本站所有资源文章禁止商业使用运营!

下载安装【程序员客栈】APP

实时对接需求、及时收发消息、丰富的开放项目需求、随时随地查看项目状态

评论