为解决调用外部大模型API存在的数据安全风险、网络依赖和高昂成本问题,自主完成5个大模型(qwen2.5:7b、phi3.5:3.8b、deepseek-r1:1.5b、tinyllama、qwen:0.5b)的本地化部署,并设计多模型智能切换方案,实现不同任务场景下的最优模型路由。

点击空白处退出提示

为解决调用外部大模型API存在的数据安全风险、网络依赖和高昂成本问题,自主完成5个大模型(qwen2.5:7b、phi3.5:3.8b、deepseek-r1:1.5b、tinyllama、qwen:0.5b)的本地化部署,并设计多模型智能切换方案,实现不同任务场景下的最优模型路由。

1.多模型本地化部署:基于Docker+0llama完成5个模型的部署,涵盖中文对话、代码生成、复杂推理等场景

2.智能路由系统:根据任务类型(代码/对话/推理/快速响应)自动选择最优模型

3.模型切换方案:支持API参数切换、环境变量切换、反向代理切换三种模式

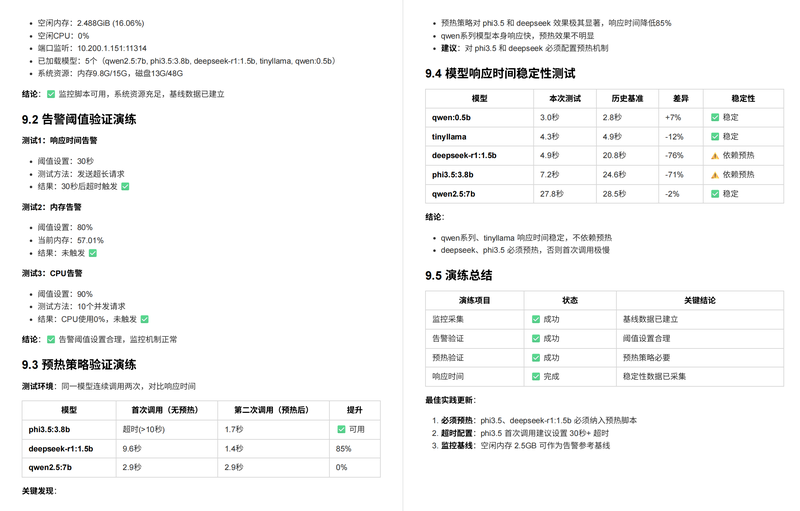

4.监控告警体系:响应时间、错误率、资源占用监控,告警阈值验证

5.预热优化机制:解决首次调用慢问题,phi3.5响应时间从超时优化至1.7秒(提升85%)

1.环境部署:配置静态IP、防火墙规则、Docker镜像加速,完成Ollama容器化部署

2.模型管理:下载并管理5个模型,总大小约9GB,输出完整部署手册

3.路由开发:基于实测数据(qwen:0.5b2.8秒、deepseek20.8秒)设计智能选型算法

4.监控体系:开发监控采集脚本、告警验证脚本、预热测试脚本

5.文档输出:完成《DeepSeek环境部署与迁移手册》《大模型模式切换方案v2.0》

评论